Mantenerse al día con una industria tan acelerada como la IA es una tarea difícil. Entonces, hasta que una IA pueda hacerlo por usted, aquí hay un resumen útil de las historias de la semana pasada en el mundo del aprendizaje automático, además de investigaciones y experimentos notables que no hemos cubierto por sí mismos.

Esta semana, Google dominó el ciclo de noticias de IA con una gama de nuevos productos lanzados en su Conferencia anual de desarrolladores de I/O. Van desde una IA generadora de código destinada a competir con el copiloto de GitHub hasta un generador de música de IA que convierte las indicaciones de texto en canciones cortas.

Un buen número de estas herramientas parecen ahorradores de mano de obra legítimos, más que marketing, claro. Estoy particularmente intrigado por Project Tailwind, una aplicación para tomar notas que usa IA para organizar, resumir y analizar archivos de una carpeta personal de Google Docs. Pero también exponen las limitaciones y deficiencias de las mejores tecnologías de inteligencia artificial de la actualidad.

Tome PaLM 2, por ejemplo, el nuevo modelo de lenguaje grande (LLM) de Google. PaLM 2 impulsará la herramienta de chat Bard actualizada de Google, el competidor de la compañía para ChatGPT de OpenAI, y funcionará como el modelo base para la mayoría de las nuevas funciones de IA de Google. Pero mientras PaLM 2 puede escribir código, correo electrónico y más LLM comparables, también responde preguntas de una manera tóxica y sesgada.

El generador de música de Google también es bastante limitado en lo que puede lograr. Mientras escribía en mis manos, la mayoría de las canciones que creé con MusicLM suenan aceptables en el mejor de los casos, y en el peor, como si un niño de cuatro años se hubiera caído en un GRAJO.

Se ha escrito mucho sobre cómo la IA reemplazará los trabajos, potencialmente el equivalente a 300 millones de trabajos de tiempo completo, según uno. relación por Goldman Sachs. En un encuesta Según Harris, el 40% de los trabajadores familiarizados con ChatGPT, la herramienta de chatbot impulsada por IA de OpenAI, temen que reemplace por completo su trabajo.

La IA de Google no es la solución definitiva. De hecho, la empresa probablemente detrás en la carrera de IA. Pero es un hecho innegable que Google emplea algunos de los mejores investigadores de IA del mundo. Y si eso es lo mejor que pueden manejar, es un testimonio del hecho de que la IA está lejos de ser un problema resuelto.

Aquí están los otros titulares importantes de AI de los últimos días:

- Meta trae IA generativa a los anuncios: Meta anunció esta semana una especie de caja de arena de IA para los anunciantes para ayudarlos a crear una copia alternativa, generación de fondo a través de indicaciones de texto y recorte de imágenes para anuncios de Facebook o Instagram. La compañía dijo que las funciones están actualmente disponibles para anunciantes selectos y ampliará el acceso a más anunciantes en julio.

- Contexto agregado: Anthropic ha ampliado la ventana emergente de Claude, su modelo de IA de generación de texto insignia, aún en vista previa, de 9,000 tokens a 100,000 tokens. La ventana emergente se refiere al texto que la plantilla considera antes de generar texto adicional, mientras que los tokens representan texto sin formato (por ejemplo, la palabra «fantástico» se dividiría en tokens «fan», «heap» y «tick»). Históricamente e incluso hoy en día, la mala memoria ha sido un obstáculo para la utilidad de la IA generadora de texto. Pero las ventanas emergentes más grandes podrían cambiar eso.

- Anthropic elogia los méritos de la «IA constitucional»: Las ventanas emergentes más grandes no son el único diferenciador de los modelos antropogénicos. Esta semana, la compañía detalló la «Constitución AI», su técnica interna de capacitación en IA que tiene como objetivo imbuir a los sistemas de IA con «valores» definidos por una «constitución». A diferencia de otros enfoques, Anthropic argumenta que la IA constitucional hace que el comportamiento de los sistemas sea más fácil de entender y más simple de ajustar según sea necesario.

- Un LLM creado para la investigación: El Allen Institute for AI Research (AI2), una organización sin fines de lucro, ha anunciado planes para formar un LLM centrado en la investigación llamado Open Language Model, que se suma a la vasta y creciente biblioteca de código abierto. AI2 ve el Modelo de lenguaje abierto, o OLMo para abreviar, como una plataforma y no solo como un modelo, una plataforma que permitirá a la comunidad de investigación tomar cada componente creado por AI2 y usarlo por sí mismos o buscar mejorarlo.

- Nuevo fondo para IA: En otras noticias de AI2, AI2 Incubator, el fondo de inicio de IA sin fines de lucro, está creciendo nuevamente a tres veces su tamaño anterior: $ 30 millones de $ 10 millones. Veintiuna empresas han pasado por la incubadora desde 2017, atrayendo unos 160 millones de dólares en inversiones adicionales y al menos una adquisición importante: XNOR, una empresa de aceleración y eficiencia de IA que luego fue adquirida por Apple por unos 200 millones de dólares.

- Reglas introductorias de la UE para la IA generativa: En una serie de votaciones en el Parlamento Europeo, los eurodiputados respaldaron esta semana una serie de enmiendas al proyecto de ley de IA del bloque, incluido el establecimiento de requisitos para los llamados modelos fundamentales que sustentan las tecnologías de IA IA generativa como ChatGPT de OpenAI. Los cambios requieren que los proveedores de modelos centrales apliquen controles de seguridad, medidas de gobierno de datos y mitigaciones de riesgos antes de lanzar sus modelos al mercado.

- Un traductor universal: Google está probando un nuevo y poderoso servicio de traducción que reproduce videos en un nuevo idioma mientras sincroniza los labios del hablante con palabras que nunca ha dicho. Esto podría ser muy útil por muchas razones, pero la empresa fue sincera sobre la posibilidad de abuso y las medidas adoptadas para evitarlo.

- Explicaciones automatizadas: A menudo se dice que los LLM similares a ChatGPT de OpenAI son una caja negra, y ciertamente hay algo de verdad en eso. En un esfuerzo por despegar sus capas, OpenAI está desarrollo una herramienta para identificar automáticamente qué partes de un LLM son responsables de cada uno de sus comportamientos. Los ingenieros detrás de él señalan que todavía está en su infancia, pero el código para ejecutarlo ha sido de código abierto en GitHub desde esta semana.

- IBM lanza nuevos servicios de IA: En su conferencia anual Think, IBM anunció IBM Watsonx, una nueva plataforma que proporciona herramientas para construir modelos de IA y brinda acceso a modelos pre-entrenados para generar código de computadora, texto y más. La compañía dice que el lanzamiento fue impulsado por los desafíos que aún enfrentan muchas empresas al implementar IA en el lugar de trabajo.

Otro aprendizaje automático

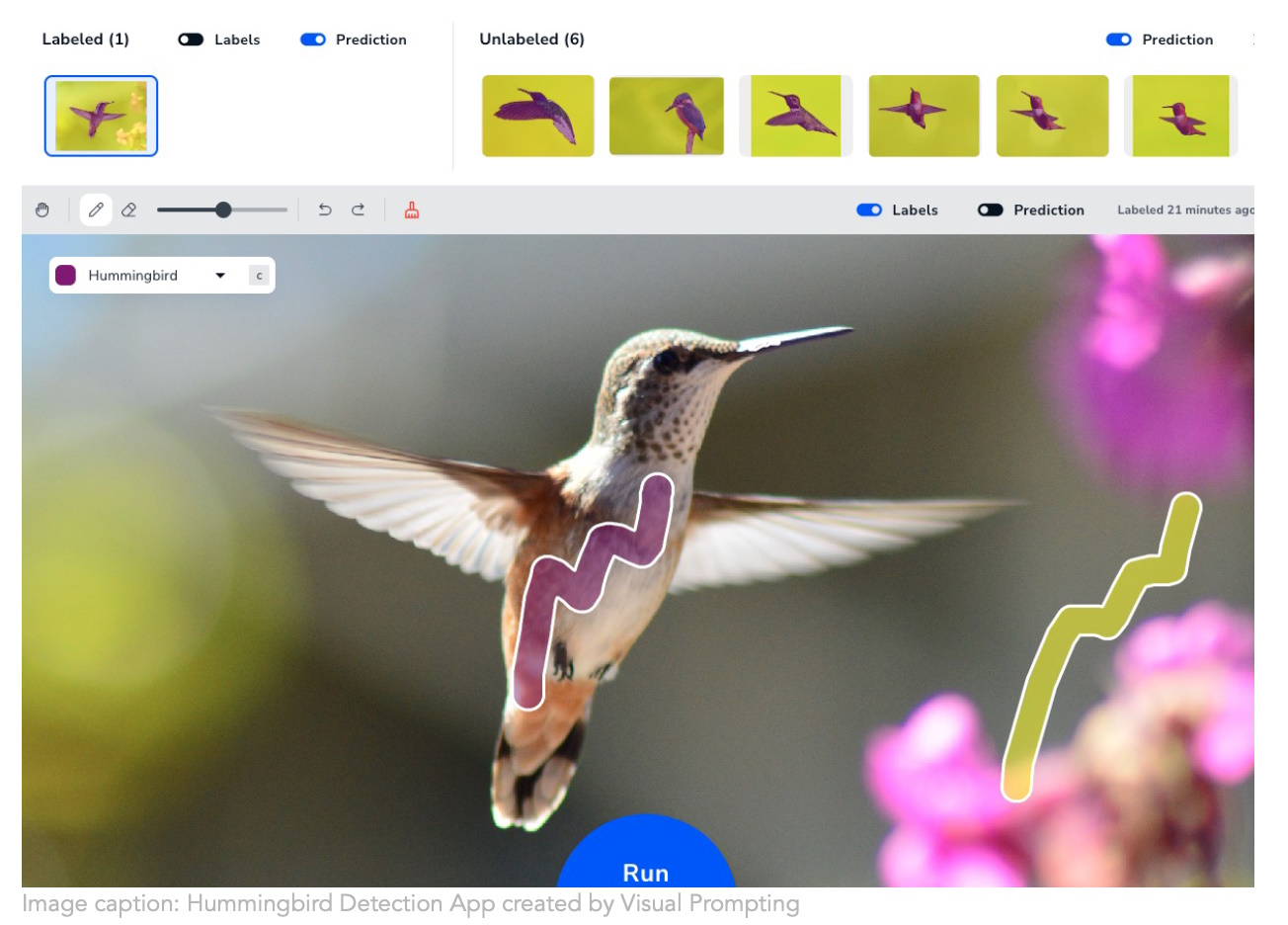

Créditos de la imagen: IA de aterrizaje

La nueva empresa de Andrew Ng IA de aterrizaje adopta un enfoque más intuitivo para crear entrenamiento de visión por computadora. Conseguir que un modelo entienda lo que se quiere identificar en las imágenes es bastante laborioso, pero su técnica de «indicación visual» te permite hacer algunas pinceladas y determina tu intención a partir de ahí. Cualquiera que tenga que construir modelos de segmentación piensa «¡Dios mío, por fin!» Probablemente muchos estudiantes de posgrado que actualmente pasan horas enmascarando orgánulos y objetos domésticos.

Microsoft aplicó patrones de dispersión de una manera única e interesante, usándolos esencialmente para generar un vector de acción en lugar de una imagen, después de entrenarlo en muchas acciones humanas observadas. Todavía es muy temprano y la transmisión no es la solución obvia para esto, pero dado que son estables y versátiles, es interesante ver cómo se pueden aplicar más allá de las tareas puramente visuales. Su trabajo será presentado en el ICLR a finales de este año.

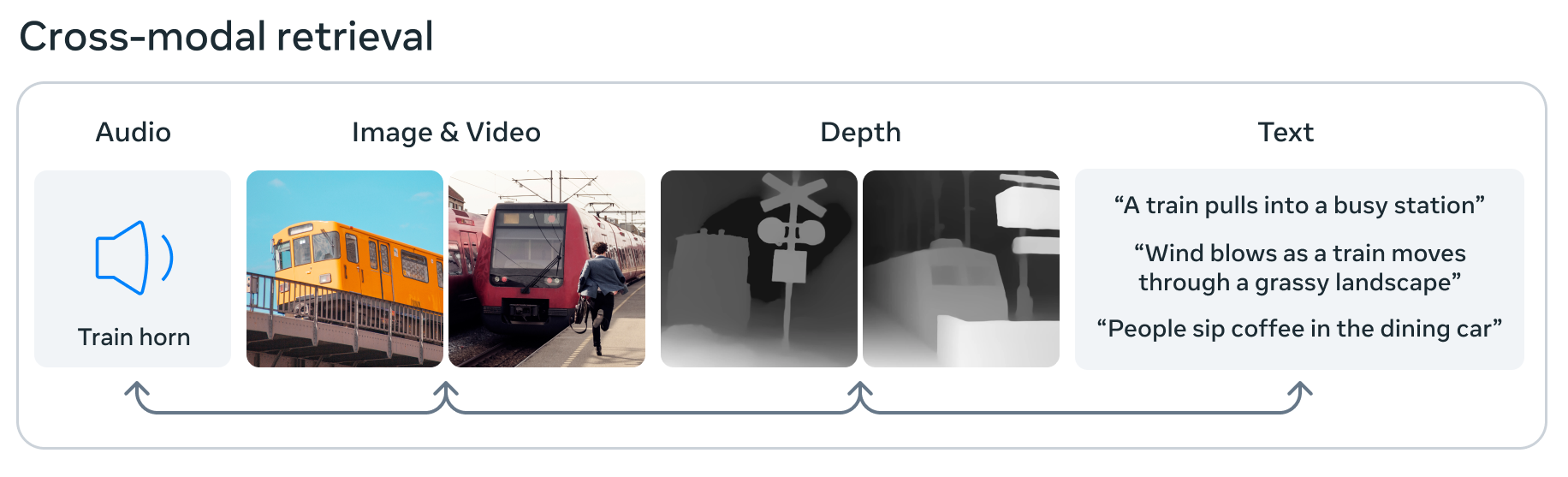

Créditos de la imagen: Meta

Meta también está ampliando los límites de la IA con enlace de imagen, que afirma es el primer modelo capaz de procesar e integrar datos de seis modalidades diferentes: imágenes y video, audio, datos de profundidad 3D, información térmica y datos de movimiento o posición. Esto significa que en su pequeño espacio de integración de aprendizaje automático, una imagen se puede emparejar con sonido, una forma 3D y varias descripciones de texto, cada una de las cuales se puede consultar o usar para tomar una decisión. Es un paso hacia la IA «convencional» en el sentido de que absorbe y asocia datos más como el cerebro, pero aún es básico y experimental, así que no te emociones demasiado todavía.

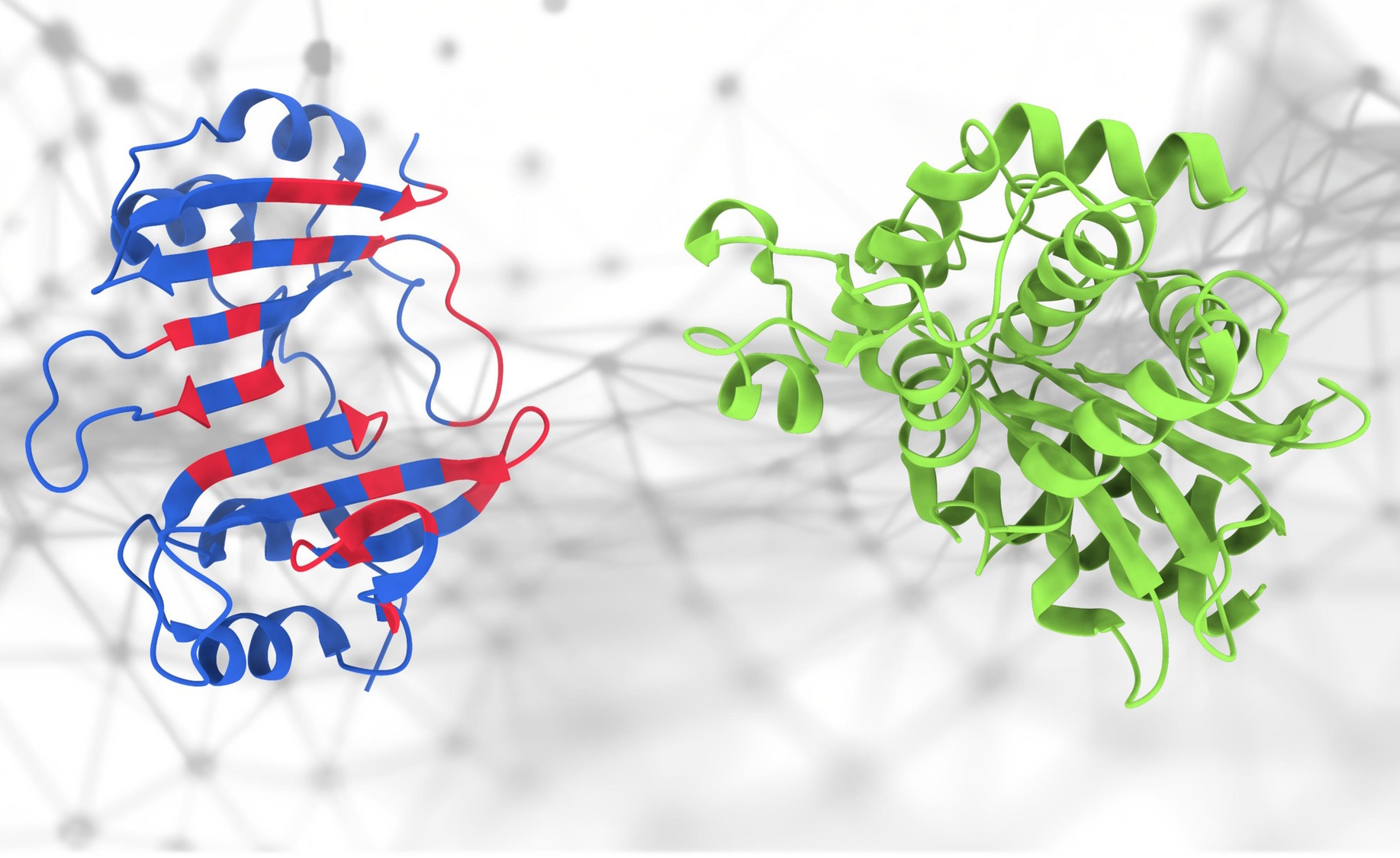

Si estas proteínas se tocan… ¿qué pasa?

Todo el mundo se entusiasmó con AlphaFold, y por una buena razón, pero la estructura es realmente solo una pequeña parte de la compleja ciencia de la proteómica. La forma en que interactúan estas proteínas es importante y difícil de predecir, pero esta nueva Modelo EPFL PeSTo intenta hacer precisamente eso. «Se centra en los átomos importantes y las interacciones dentro de la estructura de la proteína», dijo el desarrollador principal Lucien Krapp. «Esto significa que este método captura de manera efectiva interacciones complejas dentro de las estructuras de proteínas para permitir una predicción precisa de las interfaces de unión de proteínas». Si bien no es 100 % preciso o confiable, no tener que comenzar desde cero es muy útil para los investigadores.

Los federales apuestan por la IA. El presidente incluso se encontró con un reunión con un grupo de los principales directores ejecutivos de IA decir lo importante que es hacer las cosas bien. Tal vez un grupo de empresas no sean necesariamente las adecuadas para preguntar, pero al menos tendrán algunas ideas para considerar. Pero ya tienen cabilderos, ¿no?

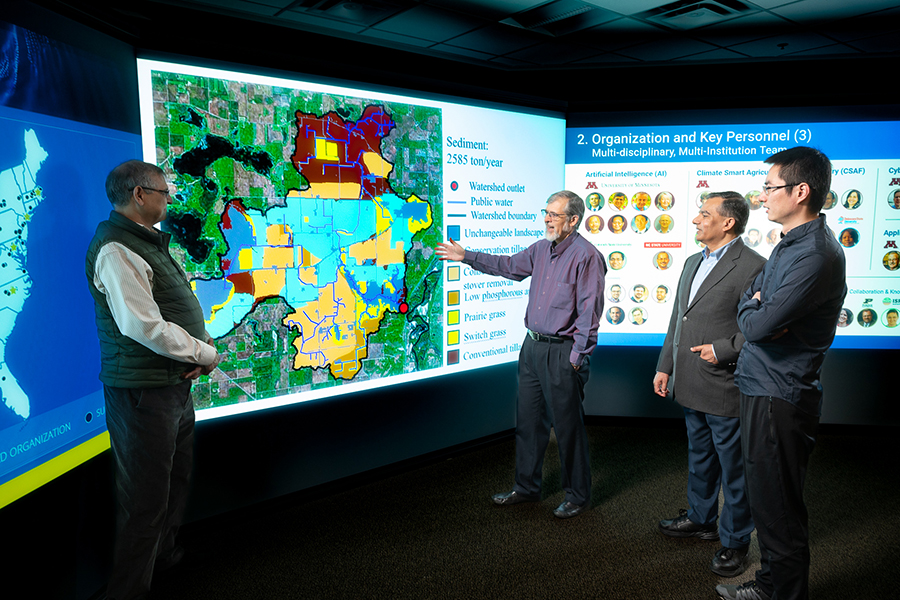

estoy más emocionado por nuevos centros de investigación de IA están surgiendo con fondos federales. La investigación fundamental es extremadamente necesaria para contrarrestar el trabajo orientado al producto realizado por OpenAI y Google. Entonces, cuando tienes centros de IA con el mandato de investigar cosas como ciencias sociales (en CMU)o el cambio climático y la agricultura (en la Universidad de Minnesota), parece campos verdes (tanto en sentido figurado como literal). Aunque también quiero dar un pequeño saludo a eso. Meta-investigación sobre medición forestal.

¡Hacer IA juntos en la pantalla grande es ciencia!

Muchas conversaciones interesantes sobre IA. Yo pensaba esta entrevista con los académicos de UCLA (mi alma mater, go Bruins) Jacob Foster y Danny Snelson Fue interesante. Aquí hay una gran idea sobre los LLM para fingir que encontraste este fin de semana cuando la gente habla de IA:

Estos sistemas revelan cuán formalmente consistente es la mayoría de la escritura. Cuanto más genéricos sean los formatos simulados por estos modelos predictivos, más eficientes serán. Estas evoluciones nos empujan a reconocer las funciones normativas de nuestras formas y potencialmente a transformarlas. Después de la introducción de la fotografía, que es muy buena para capturar el espacio de representación, el medio pictórico desarrolló el impresionismo, un estilo que rechazó por completo la representación precisa en favor de la materialidad de la pintura misma. .

¡Definitivamente usando esto!