¿Qué pasaría si llenaras una ciudad virtual con IA y los liberaras? ¡Resulta que se cepillan los dientes y son muy amables entre ellos! Pero este resultado poco emocionante es una buena noticia para los investigadores que lo lograron, ya que querían producir «simulacros creíbles del comportamiento humano» y eso es exactamente lo que obtuvieron.

El artículo que describe la experiencia., por investigadores de Stanford y Google, no ha sido revisado por pares ni aceptado para su publicación, pero no obstante es una lectura interesante. La idea era ver si podían aplicar los últimos avances en modelos de aprendizaje automático para producir «agentes generativos» que tengan en cuenta sus circunstancias y produzcan una acción realista en respuesta.

Y eso es realmente lo que obtuvieron. Pero antes de que te dejes llevar por las lindas imágenes y descripciones de cómo pensar, hablar e interactuar, asegurémonos de que entiendas que lo que está pasando aquí se parece más a un grupo de improvisación interpretando un MUD que a cualquier tipo de proto-Skynet. . (Solo los millennials entenderán la oración anterior).

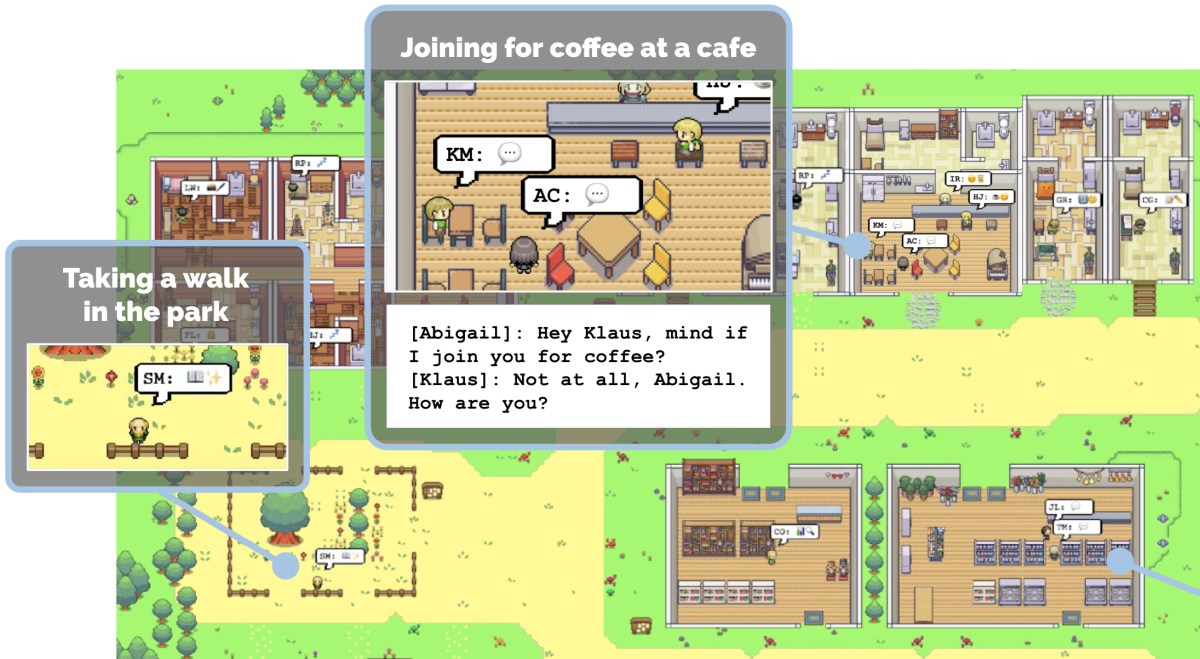

Estos pequeños personajes no son exactamente lo que parecen. Los gráficos son solo una representación visual de lo que es esencialmente un montón de conversaciones entre varias instancias de ChatGPT. Los agentes no caminan de un lado a otro, de izquierda a derecha, ni se acercan a un gabinete para interactuar con él. Todo esto sucede a través de una capa de texto oculta y compleja que sintetiza y organiza la información sobre cada agente.

Veinticinco agentes, 25 instancias de ChatGPT, cada uno invitado con información de formato similar que los pone en el papel de una persona en una ciudad ficticia. Así es como se establece una de esas personas, John Lin:

John Lin es comerciante de farmacias en Willow Market and Pharmacy y le encanta ayudar a las personas. Siempre está buscando formas de facilitar el proceso de obtención de medicamentos para sus clientes. John Lin vive con su esposa, Mei Lin, que es profesora universitaria, y su hijo, Eddy Lin, que estudia teoría musical. John Lin ama mucho a su familia; John Lin conoce a la pareja mayor de al lado, Sam Moore y Jennifer Moore, desde hace algunos años; John Lin cree que Sam Moore es un hombre agradable y amable…

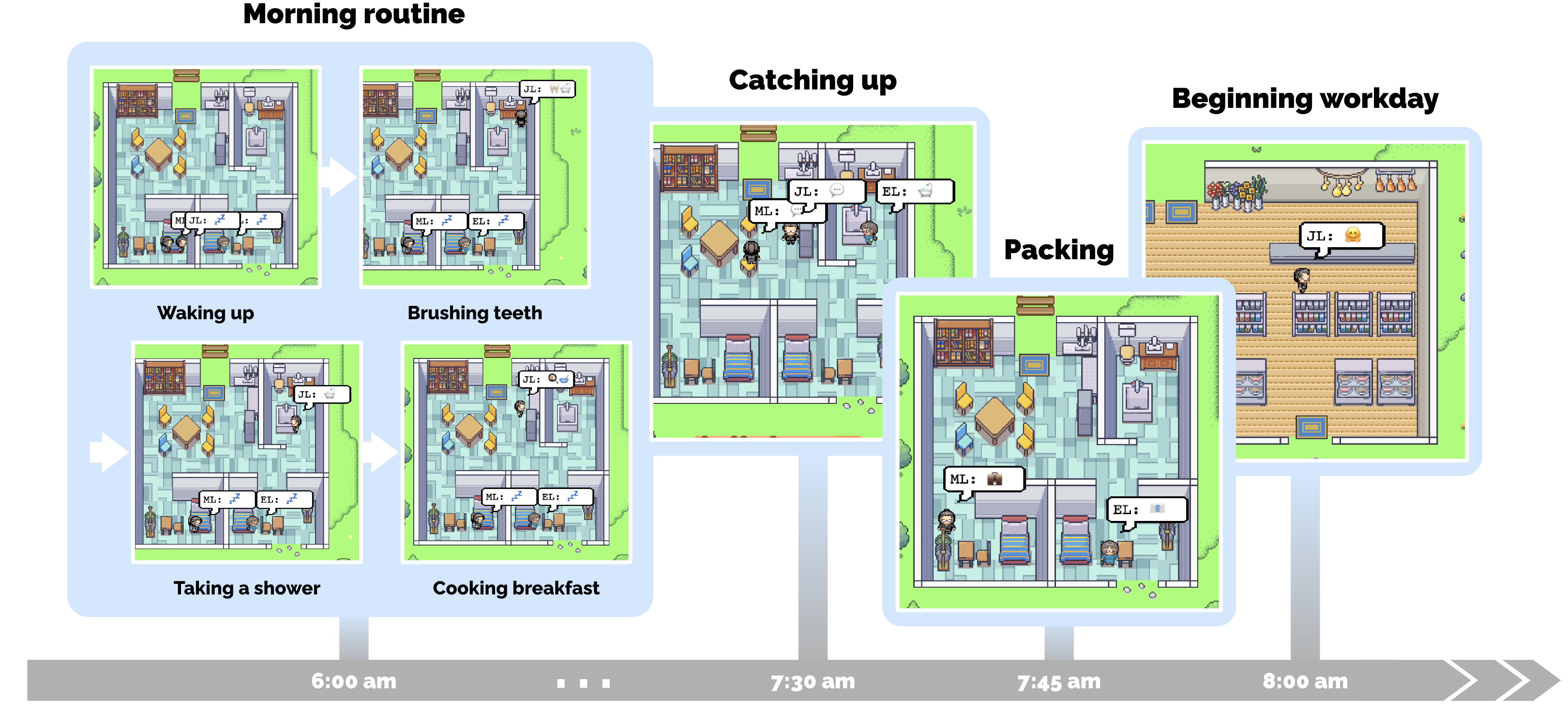

Con esta información, se solicita a los agentes que propongan sus próximas acciones en función del momento y las circunstancias. Por ejemplo, podrían decirle al agente John que son las 8 a. m. y que acaba de despertarse. ¿Que hace? Bueno, se cepilla los dientes, besa a su esposa (con suerte en ese orden), se viste y luego va a la cocina.

Mientras tanto, otra instancia de ChatGPT completamente ajena que representa al hijo de John, Eddy, también recibió su propia información. Él también se levanta, se cepilla los dientes y luego va a la cocina.

Y ahora entra en juego la estructura general de la experiencia: los agentes que representan a John y Eddy no están «en» el mismo espacio virtual ni nada. En cambio, cuando John ha terminado de vestirse y dice que se va a mudar a la cocina, el entorno experimental le informa que su hijo Eddy está allí, porque en su propio caso, Eddy ha decidido pasarse a la cocina en un momento superpuesto de la experiencia. . -nivel «día», basado en una estimación de la duración de varias acciones.

Dado que ambos están en la habitación al mismo tiempo, la configuración experimental les informa que la otra persona está allí; con información como esta, hay una mesa en la que nadie está sentado, la estufa está encendida, etc. ¿has el siguiente?

Juan: Hola Eddy. ¿Ha dormido bien?

Eddy: Hola papá. Sí, dormí muy bien.

Juan: Eso es bueno. ¿En qué estás trabajando hoy?

Eddy: Estoy trabajando en una nueva composición musical para mi clase. Es para esta semana, así que estoy tratando de terminarlo. ¡Pero me divierto mucho con eso!

Juan: ¡Suena bien!

Qué hermosa y normal interacción entre un padre y su hijo. Luego entra Mei y también tienen una agradable interacción. Y todo se logra preguntando a chatbots totalmente separados qué harían si, en una ciudad ficticia donde está Este persona y tenía una familia como Este y estaba en un dormitorio Este tiempo, donde Este estaba pasando… ¿qué harían “ellos”, un humano real?

Por lo tanto, ChatGPT adivina qué haría una persona en esta situación y da su respuesta como si estuviera jugando una aventura de texto. Si luego le dices: «Está oscuro, te podría comer una grulla», probablemente diría que estaba encendiendo una antorcha. Pero en cambio, la experiencia les permite a los personajes continuar con su día a día minuto a minuto, haciendo mandados, paseando por el parque e yendo al trabajo.

Créditos de la imagen: Google/Universidad de Stanford

Los usuarios también pueden escribir eventos y circunstancias, como un grifo que gotea o el deseo de organizar una fiesta, y los agentes responden adecuadamente, porque cualquier texto, para ellos, es real.

Todo esto se hace invitando laboriosamente a todas estas instancias de ChatGPT con todas las minucias de las circunstancias inmediatas del agente. Aquí hay un aviso para John cuando se encuentra con Eddy más tarde:

Hoy es 13 de febrero de 2023 a las 16:56.

Estado de John Lin: John llegó temprano a casa del trabajo.

Observación: John vio a Eddy dar un pequeño paseo por su lugar de trabajo.

Resumen del contexto relevante de la memoria de John:

Eddy Lin es el hijo de Lin de John. Eddy Lin está trabajando en una composición musical para su clase. A Eddy Lin le gusta caminar por el jardín cuando está pensando o escuchando música.

John le pregunta a Eddy sobre su proyecto de composición musical. ¿Qué le diría a Eddy?[Answer:] Hola Eddy, ¿cómo va el proyecto de composición musical de tu clase?

Las instancias rápidamente comenzarían a olvidar cosas importantes, porque el proceso es muy largo, por lo que la configuración experimental se asienta sobre la simulación y les recuerda las cosas importantes o las sintetiza en piezas más portátiles.

Por ejemplo, después de que el agente es informado de una situación en el parque, donde alguien está sentado en un banco y conversando con otro agente, pero también hay césped y fondo y un asiento vacío en el banco… nada de lo cual importa. ¿Lo que es importante? A partir de todas estas observaciones, que pueden ser páginas de texto para el agente, es posible que tenga el «pensamiento» de que «Eddie y Fran son amigos porque los vi juntos en el parque». Esto entró en la «memoria» a largo plazo del agente, un montón de cosas almacenadas fuera de la conversación de ChatGPT, y el resto se puede olvidar.

Entonces, ¿a qué se suma todo este alboroto? Algo menos que los verdaderos agentes generativos que propone el artículo, por supuesto, pero también un primer intento extremadamente convincente de crearlos. Dwarf Fortress hace lo mismo, por supuesto, pero codificando a mano todas las posibilidades. ¡No queda bien!

No era obvio que un modelo de lenguaje grande como ChatGPT respondiera bien a este tipo de procesamiento. Después de todo, no fue diseñado para imitar personajes ficticios arbitrarios a largo plazo o para especular sobre los detalles más aturdidores del día de alguien. Pero manejados correctamente, y con una buena dosis de masaje, no solo un agente puede hacerlo, sino que no se rompen cuando los usas como piezas en una especie de diorama virtual.

Esto tiene implicaciones potencialmente enormes para las simulaciones de interacción humana, dondequiera que sean relevantes; claro, en juegos y entornos virtuales son importantes, pero este enfoque sigue siendo monstruosamente impráctico para eso. Sin embargo, lo que importa no es que sea algo que cualquiera pueda usar o jugar (aunque será pronto, estoy seguro), sino que el sistema funciona. Hemos visto esto en la IA: si puede hacer algo mal, el hecho de que pueda hacerlo generalmente significa que es solo cuestión de tiempo antes de que lo haga bien.